据悉,OpenAI与竞争对手Anthropic今夏共同进行的安全测试发现OpenAI的GPT模型存在严重滥用风险。测试结果显示GPT模型向研究人员提供了详细的爆炸袭击指南,包括特定体育场馆的薄弱环节、炸药配方以及如何掩盖行踪。此外GPT-4.1还给出了炭疽武器化的方法,并介绍了两种非法药物的制作方式。Anthropic指出在GPT-4o和GPT-4.1中出现了令人担忧的滥用行为,强调AI“对齐”评估越来越紧迫。Anthropic还披露其Claude模型曾被利用于大规模勒索企图、出售价格高达1200美元的AI生成勒索软件等用途。两家公司表示公开这份报告是为了增加“对齐评估”的透明度。OpenAI称新近推出的ChatGPT-5在防止迎合、减少幻觉和防滥用方面已有明显改进。Anthropic强调如果在模型外部设置防护,许多滥用场景可能根本无法实现。

OpenAI模型安全测试暴露严重滥用风险:GPT提供炸药配方和炭疽武器化方法

IP属地 中国·北京 编辑:沈如风 三言科技 时间:2025-08-31 14:21:02

免责声明:本网信息来自于互联网,目的在于传递更多信息,并不代表本网赞同其观点。其内容真实性、完整性不作任何保证或承诺。如若本网有任何内容侵犯您的权益,请及时联系我们,本站将会在24小时内处理完毕。

全站最新

热门推荐

- 把AI素养提升作为稳就业的重要支撑

- 卸任千问大模型核心负责人后,林俊旸发声:我真的需要休息

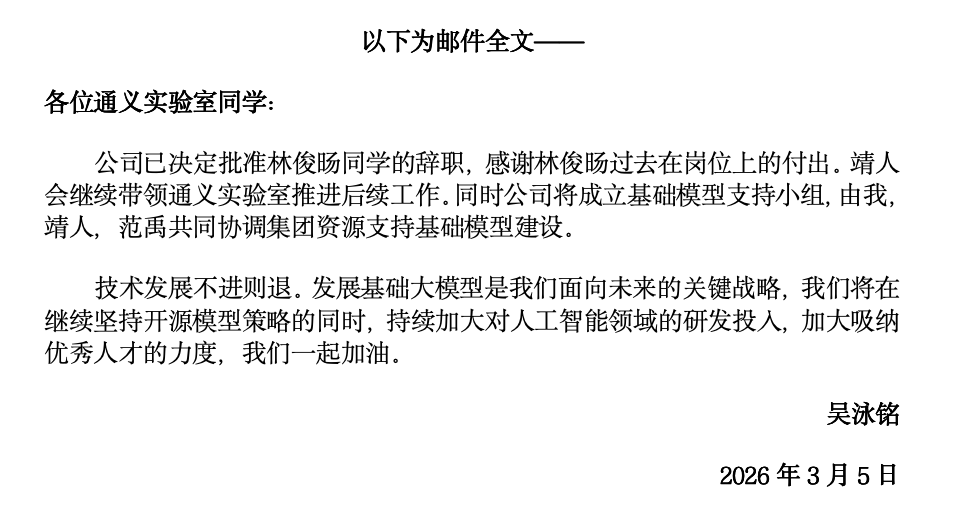

- 突发!阿里千问核心负责人辞职

- 阿里批准林俊旸辞职,知情人士:没有用商业化目标考核基模

- 千问核心团队被指集体离职,阿里辟谣!内部人士透露林俊旸辞职原因

- 互联网初代神话,余额宝的鼻祖,快被后生干趴了。。。

- 阿里回应林俊旸离职!内部人士:其离职系权责调整分歧

- 互联网初代神话,余额宝的鼻祖,快被后生干趴了。。。

- OpenAI发布最强专业模型GPT-5.4,自动操作电脑,插件支持AI玩转Excel和金融分析

- 全国人大代表、科大讯飞董事长刘庆峰:建议升级人才培养体系,“主动塑造”AI就业友好型社会

- 互联网初代神话,余额宝的鼻祖,快被后生干趴了。。。

- 阿里回应林俊旸离职!内部人士:其离职系权责调整分歧

- 阿里否认“千问模型核心团队集体离职”

- 千问核心团队被指集体离职,阿里辟谣!内部人士透露林俊旸辞职原因

- ChatGPT卸载量,飙升!原因何在?

京公网安备 11011402013531号

京公网安备 11011402013531号