闻乐 发自 凹非寺

量子位 | 公众号 QbitAI

都说苹果AI慢半拍,没想到新研究直接在Transformer头上动土。(doge)

「Mamba+工具」,在Agent场景更能打!

在最新论文《To Infinity and Beyond》中,研究团队发现:

在长任务、多交互的Agent式任务中,基于SSM架构(状态空间模型)的模型,比如Mamba,在效率与泛化能力上,展现出超越Transformer的潜力。

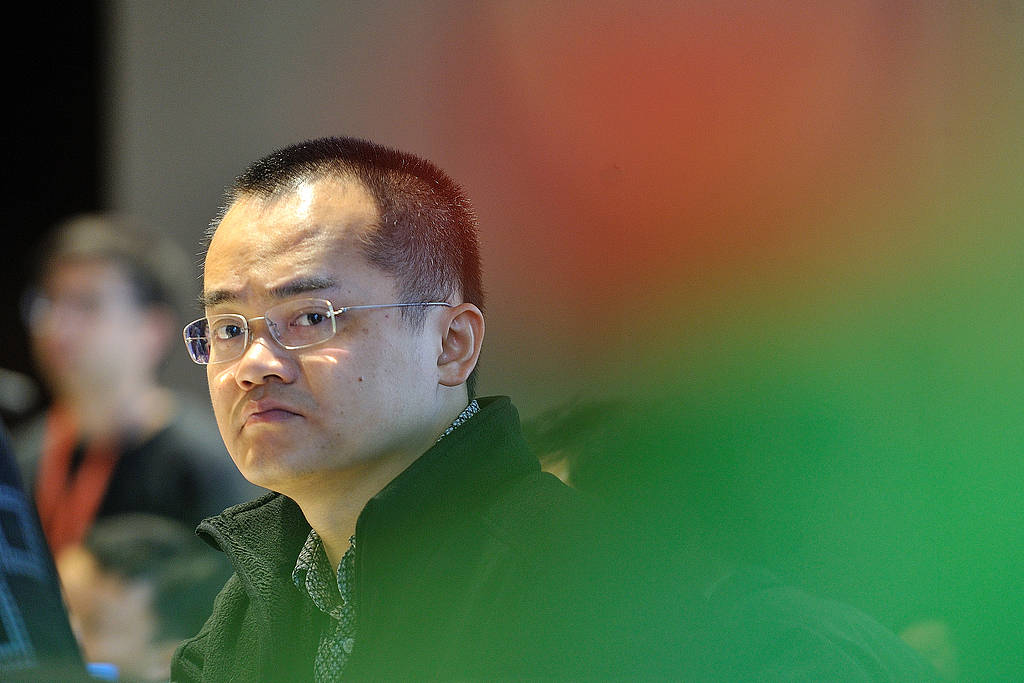

Mamba一作表示:

超越Transformer,怎么说?

Transformer的长篇累牍问题

先说说Transformer的“富贵病”。

Transformer确实很聪明,靠自注意力机制能够同时关注输入序列中所有词语之间的关联,比如阅读文章时可以快速建立首尾关键信息的联系。

但这种能力的实现需要较高的计算成本,随着输入序列长度的增加,其计算量会呈平方级增长。

例如,输入1000个词时,需要处理1000×1000=100万次词对关系;

要是处理有上万个词的长文档,计算量会达到亿级,这对普通GPU来说是不小的负担。

而这种计算成本过高的问题还会引发连锁反应:

首先是处理延迟显著增加。在长序列任务中,模型的响应速度会大幅下降;其次,在Agent类任务中表现不佳。Agent任务通常需要动态决策与迭代优化的能力,而Transformer在每一步操作中都需重新计算全局注意力,这就会导致整体效率偏低,难以满足此类任务对实时性和灵活性的需求。

相比之下,Mamba则采用了更为轻量化的设计思路。

「Mamba+工具」更高效

作为状态空间模型(SSM)的一种,Mamba不依赖全局注意力机制,而是通过持续更新的内部状态来理解输入信息

有点像人写流水账,只记最近进展,不翻旧账。

这种机制带来了三项显著优势:

计算量随序列长度呈线性增长例如处理1000个词仅需对应数量级的计算,远低于Transformer的消耗;支持流式处理能够边接收输入边进行计算,无需等待完整序列加载完毕;内存占用保持稳定不会随序列长度增加而显著上升,在效率方面表现突出。

不过,Mamba也有个明显局限:内部状态的存储容量有限,在处理超长序列任务时,早期信息容易被后续输入覆盖,导致模型对前文关键信息的保留能力较弱。

针对这一问题,苹果团队提出了新方案——通过引入外部工具扩展模型的信息处理能力

比如算数学题时用指针工具记数字、存进位;修代码时用文件查看工具反复读代码、用运行工具测报错……

这些工具可以在任务执行过程中提供辅助,相当给模型提供了可动态调用的外部存储和交互接口。

这样做的结果就是,引入工具后Mamba的性能得到显著提升:

在多位数加法任务中,配备指针工具的Mamba展现出良好的泛化能力,经过5位数加法训练后,能够稳定处理1000位数的计算,准确率接近100%,而Transformer在处理20位数时已出现明显误差;

在代码调试任务中,让Mamba模拟交互式调试流程(查看文件、局部修改、执行验证的迭代方式),面对复杂度高于训练集的代码库,其正确率显著高于Transformer;

在逻辑推理及汉诺塔等需要分步规划的任务中,结合工具的Mamba能够应对更复杂的问题场景,Transformer则要么算得慢,要么直接卡壳……

可以看出,Transformer聪明但慢,做事情讲究从头到尾一步到位,遇上需要反复调整的Agent式任务,就显得又贵又笨重;

Mamba反应快但记性差,但装上外置大脑后补足记忆短板后,效率嘎嘎提升。

这么一看,「Mamba+工具」的组合可能真要在Agent场景下抢Transformer的风头了。

论文地址:https://arxiv.org/pdf/2510.14826

参考链接:https://x.com/_albertgu/status/1980287154883358864

— 完 —

京公网安备 11011402013531号

京公网安备 11011402013531号