开年以来,AI行业最大的变化,就是Token成为日常工作的基础配置。

以OpenClaw为代表的AI智能体爆发,按Token计费的算力消耗也一路飙升。黄仁勋就表示,未来工程师的年薪里要包含Token预算,比例甚至可能达到年薪的一半。而腾讯、阿里也被曝出,开始向员工发放AI调用额度。

面对这股Token热潮,很多企业管理者和IT负责人都在犯愁:以前给员工发工资,发完现金就完事,可现在还得额外给员工发Token,而这些Token本质都来自算力,传统8卡机力不从心,动辄百卡、千卡的超大集群,是中小企业难以承受之重。

怎么搞到足够的Token给员工花?成了企业智能化的头号难题。

恰逢2026年中关村论坛召开,以“科技创新与产业创新深度融合”为主线,算力趋势也在与会嘉宾的交流中得到了印证。现实中,算力已经从少数科技巨头的战略资源,成为更多组织的基础配置。在此背景下,中科曙光于论坛现场,发布了世界首个无线缆箱式超节点scaleX40并开启全渠道预售,为企业算力选型提供了更普惠的选择。

当下,企业落地AI正在告别不计成本的FOMO扩张期,进入精打细算的务实阶段,就连OpenAI都在主动下调算力支出规划。所以,超节点不能成为企业现金流的碎钞机,打破越大越好的规模迷信正当其时。如何找到算力投入与业务价值的黄金平衡点,有必要先洞穿一下企业算力的成本陷阱。

云端算力虽然灵活,可一旦AI在业务中规模化落地,按Token计费的成本就会呈指数级暴涨,企业反倒沦为给云厂商打工。所以,仍有大量企业选择自建算力基础设施,相当于自己造一座Token工厂。

可自建算力的道路,同样布满陷阱。

绝大多数企业的主流AI应用场景,集中在推理、后训练环节。这时候,传统8卡服务器性能严重不足,面对多智能体协作、高并发实时推理等复杂需求,就像小马拉大车,满足不了企业用AI的需求,这类传统基建的投入实属无效投资。

但盲目追求千卡、万卡级别的大型集群,不仅成本高,还要面临复杂运维,从来都是头部互联网大厂的专属配置。而且,大多数企业内部的AI用量是缓慢上升的,可能一段时间里,真金白银买来的大型集群都处于闲置空载状态,算力资源利用率低,也让重金采购的超节点变成了24小时不停运转的碎钞机。

这就是当下企业AI落地的真实困境:想吃到AI红利的甜,却得先品尝算力选型的苦。

既有支撑复杂推理的实力,又不能贵得让企业望而却步,成了智算产业必须解决的问题。在2026年中关村论坛,业界共识是,30~70卡正在成为当下算力甜点区间。

不同阶段,企业引入的AI应用与需求不同,算力甜点也会随之变化。据中科曙光的专家透露,2025年DeepSeek爆火,当时的八卡一体机能够满足对话式AI的推理需求,算是企业算力甜点。而进入2026,一方面企业AI应用场景增多,另一方面出现了OpenClaw这类高度自动化、Token消耗量巨大的新应用,所以企业算力的甜点区间也发生了位移。

当前,30卡~70卡的中小规模超节点,是企业算力的最佳甜点区间。这个区间是怎么测算出来的呢?

最核心的考量,是企业的实际业务场景与使用量。

当前,企业核心的应用场景分为高中低三类,相当于小杯、中杯和大杯。其中,个人办公助理、OCR识别等小并发、单一场景推理需求,30卡规格就能轻松支撑;通用大模型预训练、超高并发Agent服务等极少数场景,模型参数在671B以上,往往需要百卡以上集群。但绝大多数企业,都不会自主训练基础模型,普遍选择API+微调+应用,来进行智能化,因此算力需求主要集中在实时推理、高并发、行业模型微调等,70卡以内的中小规模超节点,就能够满足这一主力区间的需求。

因此,将32~70卡的中小规模超节点,作为算力甜点区,对企业可以带来几方面的价值:

一是模型性能匹配。低于30卡,面对中等算力场景会出现显存爆满、推理延迟飙升的问题,比如员工跟智能体说一句话都要等上几十秒,这种体验是不可能被业务侧所接受的。通过Scale-Up全互连架构,30卡~70卡可以形成超大统一显存池,突破单卡显存物理瓶颈,支撑千亿参数大模型推理、长上下文交互等高阶需求。

二是业务场景覆盖。无论是企业内部私有化知识库搭建、垂直行业专属大模型微调,还是智能体高并发实时推理、多任务协同处理,30卡~70卡的中小规模超节点都能完美承接,适配90%的企业级AI应用刚需场景,再结合灵活拓展的能力,能够快速应对后续模型迭代、Token用量激增也完全够用。

三是成本合理控制。超节点规模越大,硬件采购、机房运维、电力消耗等开支也会指数级增加,边际效益递减。30卡~70卡区间,刚好平衡了业务载荷与成本控制。以区间核心40卡为例,中科曙光在scaleX40单节点集成40张GPU,在保障算力充足的同时,系统可靠性提升至99.99%,也降低了架构复杂度,稳定性、能效性可有效降低运维成本,全方位帮企业控制综合成本。

归根结底,企业部署超节点,还是得静下心回归业务本质:假如做AI的最终目的,是落地变现、驱动增长,那么30卡~70卡的中小规模超节点,就是90%企业的最优解。

可能很多人会问:道理都懂,可市面上为什么没有满足实际需求的中小规模超节点?需要砸墙凿壁才能部署的超大算力巨兽,让中小企业望而却步。

根源就在于传统架构的硬伤。超节点的巨型机柜、复杂液冷散热、杂乱铜缆布线等,太难伺候,跟大部分企业的现有机房完全无法适配。

深耕高性能计算起家的中科曙光,从早期的超级计算机,到现在的大模型算力,打造了无数个世界领先级的系统。在推出全球首个单机柜级640卡超节点scaleX640之后,曙光洞察到,超节点不能只是少数头部玩家的顶配装备,90%企业需要的普惠超节点,仍是市场空白。要帮助各行各业的企业实现AI化转型,就必须有企业主动突破传统超节点的技术壁垒,而曙光恰好积累了大量的工程和研发经验,于是聚焦在30卡~70卡这一算力甜点区间,补齐这一关键生态位,打造出世界首款无线缆箱式超节点scaleX40。

假如企业使用AI,遇到下面这些烦恼时刻,scaleX40可能会是反复权衡之后的最佳收益点。

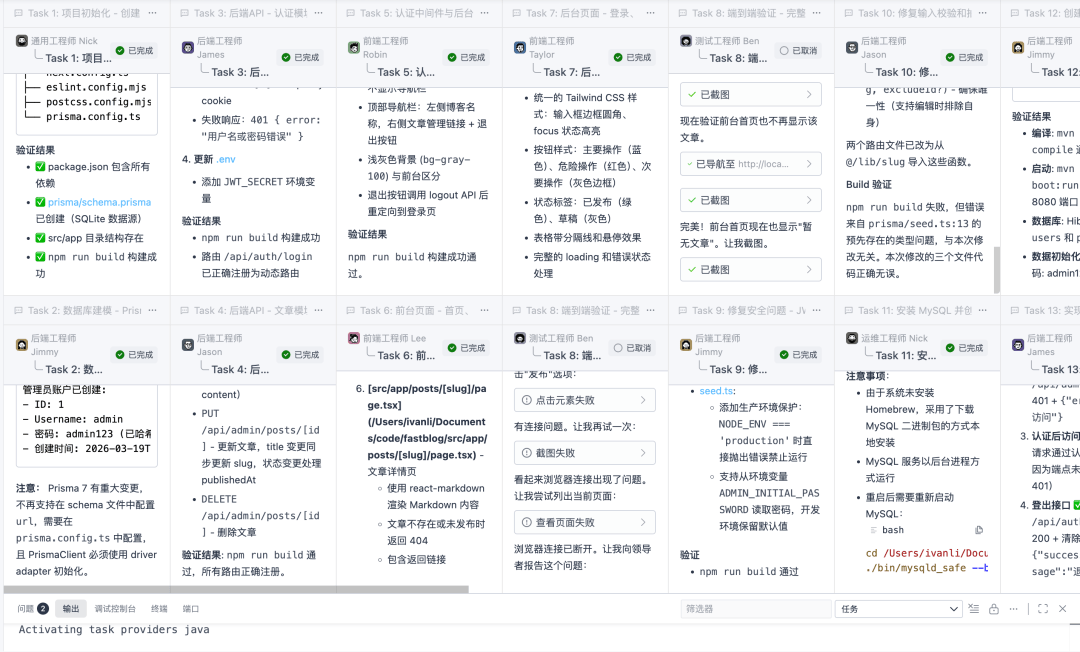

第一个时刻,当业务人员想把AI智能体(比如OpenClaw)引入工作场景,发现算力不够,服务器一直繁忙。

传统服务器部署要改机房、调试要花好几天。而scaleX40是无线缆正交设计,不用复杂布线,买回来即插即用,像部署一台普通服务器一样简单便捷,不用一次性投入重金换设备。加上它的开放架构,和各种软件、模型、合作伙伴无缝衔接,不用额外调试适配,主流AI应用day0级上线。私有化部署还能保证业务数据不泄露,让企业智能体、本地养龙虾成为可能,帮助员工提升效率。

第二个时刻,是研发部门需要训练行业大模型、进行复杂推理的时候。

不管是调优行业专属模型,还是处理海量数据、做高并发咨询,传统服务器要么卡顿半天,要么显存不够崩掉。scaleX40集成了144G大显存,还用40卡高带宽一级互连,把通信延迟降到最低,所有算力卡打通形成超大统一显存池,单机就能支撑万级并发交互。不管是万亿参数大模型推理、长上下文交互,还是智能体高并发任务处理,都能流畅运行。

第三个时刻,是IT同事日常运维的时候,集群复杂度越高,出故障就是必然的,而中小企业的IT人员储备,在应对超大算力集群力不从心。

因此,scaleX40作为普惠超节点,进行了全链路极简优化。一方面抛弃铜缆布线,改用无线缆正交对接架构,免去了繁琐的理线工作,消灭了运维噩梦,又大幅降低硬件损耗,设备可靠性提升到99.99%,很少出故障。此外,搭载SothisAI一站式平台,从模型训练、推理部署到日常监控、故障排查,全流程闭环操作,就算有问题也能快速排查,再也不用担心硬件故障耽误进度。

说到底,超节点的产品创新,要能实实在在解决企业日常工作中的痛点。不管是普通员工用AI智能体办公,还是负责人控制预算、考虑建设周期,都能感受到算力甜点带来的价值与效率,算力建设变苦为甜,可能是scaleX40问世的最大价值。

站在整个企业AI落地的行业视角来看,40卡箱式超节点的出现,或许将是企业算力投入逻辑的拐点。

时间来到2026年,AI行业已经到了弃虚务实的临界点。应用层,OpenClaw凭借任务自主执行能力而爆火,大家期盼AI应用能够真正解决问题、创造收益,在业务场景中释放真正的生产力。底层的算力侧也一样,企业开始告别盲目堆卡,就连OpenAI也主动下调了算力支出规划,一个精打细算的时代正式到来。

总结一下就是,每一分算力投入、每一个Token,都要带来业务价值。

对于广大企业的CTO/CIO来说,AI化转型已经成为企业不可不做的选择,算力也随之变成了硬性支出。这种情况下,超节点作为承载算力、支撑Token供应的核心载体,价值不言而喻。既要大胆布局AI,更要做清醒、理性的IT投资决策者,在算力甜点区间内合理布局、量力而行,才能让企业真正享受算力带来的甜蜜。

40卡普惠超节点scaleX40的出现,刚好踩中了这一时代需求。把极具成本压力的超节点,及时拉回了价值创造的正轨。

算力甜点的具体规格,或许会随着AI技术的进展而变化,但投入产出比最优的核心宗旨,永远不会变。所以,超节点虽好,可不能贪杯。

京公网安备 11011402013531号

京公网安备 11011402013531号