在人工智能大模型爆发式发展的今天,模型规模从百亿、千亿迈向万亿参数,应用场景从文本生成、智能问答延伸至代码编写、逻辑推理、科学计算等复杂领域。但随之而来的,是大模型推理效率低、训练成本高、长文本处理能力不足等行业共性难题。传统强化学习(RL)方法在32B级大模型中,长期陷入推理长度停滞、信号稀疏、优化方向模糊的困境。而FIPO算法的横空出世,凭借精准的技术突破,从底层重构大模型推理训练机制,不仅实现性能跃升,更重新定义了大模型的推理边界。

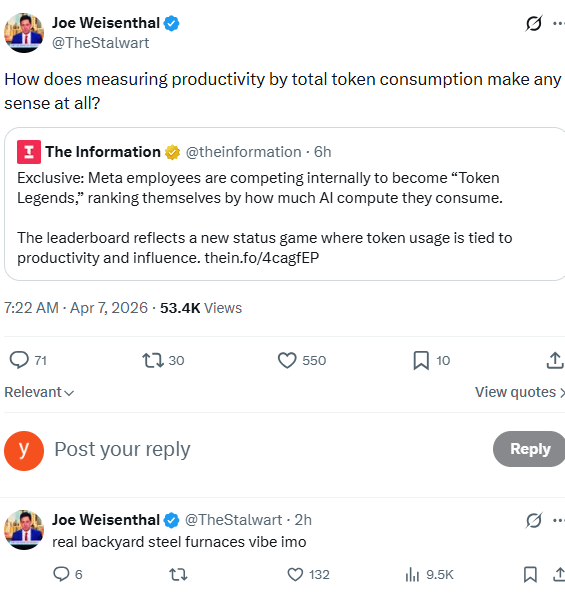

FIPO算法的核心竞争力,在于其“抓重点、去冗余”的创新逻辑。在大模型的运行过程中,海量Token(文本基本单元)中真正决定推理质量、逻辑走向的,仅占极小比例。FIPO算法通过精准识别这仅2%的关键Token,摒弃了98%的无效信息干扰,让模型训练与推理聚焦核心,实现“四两拨千斤”的性能跃升。这一创新不仅大幅降低了计算资源消耗,更让模型在处理复杂逻辑时,能够快速抓住核心要点,避免陷入冗余运算的泥潭。

更具突破性的是,FIPO算法在优化机制上实现了底层替换。传统大模型训练普遍采用KL散度作为优化指标,但其在强化学习场景中,极易出现信号稀疏、反馈模糊的问题,导致模型优化效率低下、方向偏差。而FIPO算法创新性地用符号对数概率差(Δlogp)替代传统KL散度,从数学逻辑层面解决了强化学习信号稀疏的痛点,让模型训练过程中的反馈信号更精准、更直接,每一次优化都能精准指向性能提升,彻底告别“盲目试错”的训练模式。

对比行业现状,FIPO算法的优势更为凸显。当前,传统RL方法在32B规模大模型的应用中,始终无法突破推理长度的瓶颈,模型在处理长文本、多轮对话、复杂推理任务时,极易出现逻辑断裂、内容断层,平均推理长度长期徘徊在低位。而FIPO算法凭借核心技术创新,成功打破这一行业壁垒,使大模型平均推理长度一举突破10,000 Token,实现了从“短文本处理”到“长文本深度推理”的跨越。在实际性能对比中,FIPO算法的表现更是反超o1-mini等行业主流竞品,在推理长度、逻辑连贯性、内容准确性等核心指标上,展现出压倒性优势。

从技术价值与行业意义来看,FIPO算法的突破远不止于性能提升,更在于开创了大模型优化的全新范式。一方面,它首次实现Token级差异化奖励分配,打破了传统模型“一刀切”的奖励机制,让模型能够根据不同Token的重要性,精准分配优化权重,让奖励机制更科学、更精细化,为大模型的持续优化提供了全新方向。另一方面,FIPO算法对“Oops Moment”(推理失误瞬间)现象的深入研究,为大模型推理错误溯源提供了系统性方法论。以往,大模型推理错误往往难以定位根源,而“Oops Moment”研究能够精准捕捉推理失误的关键节点,帮助开发者快速分析问题、迭代优化,大幅提升大模型的稳定性与可靠性。

当前,大模型已成为数字经济的核心基础设施,广泛渗透至办公协同、教育培训、医疗健康、科研创新、工业制造等多个领域。推理能力作为大模型的核心竞争力,直接决定其应用边界与价值上限。FIPO算法凭借其在核心创新、性能突破、技术范式上的多重优势,不仅解决了大模型行业长期存在的痛点,更推动大模型向“更长推理、更高效率、更低成本、更稳输出”的方向进阶。

未来,随着FIPO算法的持续迭代与规模化应用,大模型将解锁更多高难度应用场景——从超长文档深度分析、多领域复杂逻辑推理,到科学研究中的精准计算、工业场景中的智能决策,都将迎来能力升级。这场由FIPO算法引发的大模型推理革命,不仅将重塑人工智能行业的技术格局,更将为数字经济高质量发展注入强劲动能,推动人工智能技术真正融入千行百业,赋能生产生活。

京公网安备 11011402013531号

京公网安备 11011402013531号